14. O cérebro é como um computador?

Em 1955, um grupo de cientistas da computação solicitou à Fundação Rockefeller financiamento para um encontro de dez especialistas no Dartmouth College. Eles alegavam que pretendiam

partir da hipótese de que todos os elementos do aprendizado ou qualquer outro aspecto da inteligência podem ser descritos com tamanha precisão que uma máquina seria capaz de simulá-los. Trata-se de uma tentativa de descobrir como as máquinas podem usar a linguagem, formular abstrações e conceitos, resolver tipos de problemas hoje exclusivos dos seres humanos e se aperfeiçoar.

Os cientistas estabeleciam um programa claro e conciso, contudo, a sentença mais chocante da proposta era a que vinha logo a seguir à apresentação. Diziam eles: “Acreditamos que se possa fazer um avanço significativo em um ou mais desses itens se um grupo selecionado de cientistas trabalhar em conjunto, durante um verão.” Hoje parece óbvio que um significativo avanço da inteligência artificial só poderia surgir depois de décadas, não de “um verão”. Como explica o neurocientista cognitivo Michael Gazzaniga, o grupo era “um pouco otimista”.

No cerne do superotimismo inicial encontra-se a metáfora do “cérebro como um computador”, que, na melhor das hipóteses, é uma super-simplificação. As características funcionais do cérebro biológico são muito diferentes das dos computadores usados em 1955, ou mesmo das mais sofisticadas máquinas atuais. Um computador convencional consiste em componentes eletrônicos como transistores – uma espécie de interruptor que liga e desliga – que implementam uma série de operações lógicas chamadas portas. O lógico George Boole provou em 1854 que qualquer “expressão lógica”, incluindo cálculos matemáticos complicados, pode ser implementada por um “circuito lógico” a partir de componentes em rede construídos com apenas quatro portas fundamentais, chamadas e, ou, não e copiar. Essas portas se transformam em um ou dois bits de informação a cada vez (um bit é um registro – uma locação armazenada – que pode ter os valores 0 ou 1). Por exemplo, um não altera o 0 para 1, e vice-versa, enquanto a porta copiar altera o 0 para 00, o 1 para 11. Independentemente de seu uso, qualquer computador aplica portas eletrônicas lógicas a bits, um ou dois de cada vez. O cérebro, por sua vez, executa operações de maneira paralela, fazendo milhões de coisas ao mesmo tempo.

Há muitas outras diferenças. Os processos cerebrais são cheios de ruí do – isto é, são sujeitos a perturbações elétricas indesejáveis que degradam a informação útil –, enquanto os computadores são confiáveis. O cérebro consegue sobreviver com a remoção de neurônios individuais, enquanto as operações de um computador falham com a destruição de um só transistor funcional. O cérebro se ajusta para realizar as tarefas que lhe são propostas, enquanto os computadores precisam ser projetados e programados para o número finito de tarefas que podem efetuar. As arquiteturas físicas também são muito diferentes. O cérebro humano compreende mil trilhões de sinapses (as lacunas entre neurônios pelas quais fluem os sinais químicos e elétricos), enquanto, hoje, o sistema de um computador de muitos milhões de dólares chega a ter 1 trilhão de transistores. Além disso, embora as sinapses se pareçam um pouco com os transistores, o comportamento do neurônio é muito mais complexo que o de um componente de computador. Por exemplo, um neurônio dispara – mandando seu sinal para milhares de outros – quando os sinais agregados nos neurônios que o alimentam chegam a um limite crítico, mas deve-se considerar a sincronia dos sinais que chegam. Ainda há sinais inibidores; os neurônios podem conter elementos que modificam o efeito das mensagens recebidas. Esse é um design intrincado, de riqueza e complexidade muito maiores que as aplicadas em dispositivos eletrônicos.

Ainda assim, uma metáfora pode ser útil quando as coisas comparadas correspondem uma à outra em apenas um aspecto. Carson McCullers escreveu que “o coração é um caçador solitário”, observação maravilhosa, apesar de o coração não usar espingarda. Por isso, talvez seja proveitoso pensar no cérebro como um computador, apesar das diferenças de design físico e de operação, quando, por exemplo, o cérebro biológico e o “cérebro” do computador produzem comportamentos semelhantes. Entre animais simples e computadores avançados (pelos padrões atuais), esse pode ser bem o caso.

Vamos considerar a vespa fêmea caçadora Sphex flavipennis. Quando uma fêmea dessa espécie está pronta para botar seus ovos, ela cava um buraco e caça um grilo. A ansiosa mãe dá três ferroadas na presa, depois arrasta o inseto paralisado para o buraco e o arruma de forma que as antenas apenas toquem na abertura. Quando o grilo está posicionado, a vespa entra no túnel para fazer uma inspeção. Se estiver tudo bem, ela arrasta o grilo para dentro e põe seus ovos ao lado, para que o grilo sirva de alimento quando as larvas nascerem. Concluído seu papel de mãe, ela veda a entrada e sai voando. Assim como as ovelhas que descrevi no capítulo anterior, essas vespas fêmeas parecem agir de forma pensada, com lógica e inteligência. Mas, como notou em 1915 o naturalista francês Jean-Henri Fabre, se o grilo expressar o menor movimento enquanto a vespa inspecionar o buraco, quando sair, ela vai reposicionar o grilo na entrada e mais uma vez descer ao buraco para dar uma olhada – como se tivesse chegado com o grilo naquele momento, pela primeira vez. Na verdade, não importa quantas vezes o grilo se mover, a vespa repete todo o ritual. Afinal, parece que a vespa não é tão inteligente e racional assim, mas apenas segue um algoritmo pré-programado, um conjunto de regras fixas. Fabre escreveu: “Esse inseto, que nos espanta e nos assusta com sua extraordinária inteligência, nos surpreende no momento seguinte com sua burrice, quando confrontado com algum fato simples que aconteça fora de sua prática habitual.” O cientista cognitivo Douglas Hofstadter chama esse comportamento de “sphexinicidade”.

Se criaturas vivas podem parecer inteligentes, mas nos desapontar quando caem até o nível de sphexinicidade, os computadores digitais podem nos entusiasmar quando sobem no mérito desse mesmo rótulo modesto. Por exemplo, em 1997, uma máquina de jogar xadrez chamada Deep Blue venceu o campeão mundial da época, Garry Kasparov, num torneio de seis jogos. Kasparov disse que viu inteligência e criatividade em alguns movimentos do computador e acusou o Deep Blue de receber ajuda de especialistas humanos. No limitado domínio do xadrez, o Deep Blue não somente parecia humano, ele parecia super-humano. Embora o personagem humano Deep Blue exibido no tabuleiro fosse muito mais complexo, detalhado e convincente que os cuidados maternais demonstrados pela vespa, ele não surgiu de um processo que a maioria de nós gostaria de considerar inteligente. A máquina de 1.500 quilos tomou suas decisões que parecem humanas examinando 200 milhões de posições de xadrez por segundo, permitindo-lhe antever de seis a oito movimentos adiante, em alguns casos, vinte ou mais. Além disso, armazenava uma biblioteca de movimentos e respostas aplicáveis ao início do jogo e outra de estratégias especiais para o fim do jogo. Kasparov, por sua vez, declarou que só podia analisar algumas posições por segundo, confiando mais na intuição humana que no poder de um processador. Mesmo sem examinar o que havia debaixo do capô, há uma maneira fácil de esclarecer essas diferenças de inteligência: é só mudar um pouco o jogo. Por exemplo, alterando a posição das peças no começo do jogo – ou eliminando a regra, importante no final do jogo, que permite que um peão seja trocado por uma peça mais importante para ganhar uma posição melhor no final, avançando para o outro lado do tabuleiro. Kasparov conseguia adaptar seu raciocínio a isso. Mas o Deep Blue agia mais como a vespa, incapaz de se adequar às circunstâncias e fazer julgamentos, com sua enorme inteligência dizimada pela inflexibilidade.

O Deep Blue tinha uma capacidade sobre-humana no xadrez, mas não é o que a maioria de nós define como “inteligente”. O mesmo pode ser dito sobre Watson, o computador da IBM que jogava Jeopardy e em 2011 venceu os grandes campeões humanos. Para equipá-lo para o jogo, a IBM atulhou o computador com 200 milhões de páginas de conteúdo armazenadas em 4 mil gigabytes de espaço em disco, tudo isso turbinado com 16 mil gigabytes de memória ram e cerca de 6 milhões de regras de lógica para ajudar a chegar às respostas. Mesmo assim, apesar de acertar quase sempre, Watson obtinha as respostas a partir de pesquisas grosseiras, baseadas em correlações estatísticas, sem nada do que poderíamos chamar de uma “compreensão” da pergunta. Essa questão fica bem-esclarecida por algumas de suas respostas erradas, como a escolha de Toronto como resposta na categoria “Cidades. EUA”. Por trás de sua grande base e da impressionante capacidade para responder perguntas feitas em linguagem coloquial, não havia nada que se pudesse definir como inteligência.

O programa Jeopardy é uma invenção relativamente recente. Assim como os computadores. A primeira proposta de programar um computador para jogar xadrez como um ser humano inteligente foi feita pelo matemático Alan Turing em 1941, antes da construção da primeira máquina que pudesse ser chamada de computador eletrônico. Turing, um dos pensadores mais influentes do século XX, propôs muitas das ideias que formam as bases da ciência dos computadores e da nossa era digital. Ele reconhecia as limitações de um computador com uma inteligência sphexiniciana, confinada a um domínio específico, e argumentava que máquinas pensantes deviam ser capazes também de aprender e de alterar suas próprias configurações.

Como julgar se um computador é inteligente? Segundo Turing, a inteligência não deve ser avaliada de acordo com o processo pelo qual seres ou máquinas funcionam, mas a partir de fora, examinando-se seu comportamento. É assim que julgamos as pessoas no dia a dia – afinal, em geral não temos acesso aos sentimentos e aos raciocínios de pessoas que não conhecemos. Pouco se sabia na época de Turing sobre o detalhado funcionamento do cérebro biológico, mas ele acreditava que, fossem quais fossem as semelhanças e diferenças, acabaríamos por construir um computador com inteligência e comportamento semelhantes aos de um ser humano.

A vida de Turing e sua brilhante carreira foram abreviadas de forma trágica quando ele se suicidou, em 1954, depois de ser obrigado pelo governo britânico a passar por uma terapia hormonal, por ser gay. Mas, poucos anos antes de sua morte, ele publicou um texto intitulado “Computing machinery and intelligence”, no qual propunha um teste de inteligência agora conhecido como teste de Turing. Em sua forma atual, o teste de Turing consiste em um ser humano e um computador interagindo por meio de mensagens de texto, com um juiz humano imparcial. Se o juiz não conseguir diferenciar qual dos participantes é humano, diz-se que a máquina é inteligente. Turing previu que os computadores passariam por esse teste em meio século, ou seja, antes do ano 2000.

O teste de Turing disseminou-se na cultura popular em 1966, com um programa de computador simples, de apenas duzentas linhas, chamado Eliza, que empregava um monte de truques para gerar respostas simples, soando surpreendentemente humanas. Nas décadas que se seguiram, os cientistas da computação criaram muitos outros “robôs falantes”. Veja a seguir o trecho de um diálogo em um recente concurso com o teste de Turing. Você consegue distinguir qual falante é o juiz humano e qual é o robô?

BILL: Você conhece alguma boa piada?

JOAN: Sei até algumas piadas ruins. Mas não consigo me lembrar delas por muito tempo.

BILL: Por favor, conte uma piada.

JOAN: O que você ganha se andar por baixo de uma vaca? Bill: Não sei.

JOAN: Uma patada na cabeça.

BILL: Essa é muito boa.

JOAN: Eu sei.

Essa conversa se prolongou por 25 minutos. Na verdade, Joan é o computador. Porém, ao contrário dos projetistas de Eliza, que simplesmente seguiram roteiros fixos, o criador de Joan seguiu o conselho de Turing e construiu essa máquina para obter “inteligência” por aprendizado: o programa “conversou” on-line durante anos com milhares de pessoas reais, construindo um banco de dados de vários milhões de locuções que ele busca estatisticamente quando compõe suas respostas.

Os cientistas da computação ainda não criaram um programa que consiga enganar juízes humanos por muito tempo. Mas o reconhecimento do nível em que programas como Joan trabalha e como eles funcionam leva a duas conclusões. Primeiro: chegar à “inteligência” num teste como o de Turing num computador digital é muito mais difícil do que a maioria a princípio pensava. Segundo: há algo errado no teste de Turing – pois uma máquina que monta um discurso repetindo respostas encontradas previamente não mostra inteligência maior que um nematódeo quando exibe sua sofisticação culinária ao rastejar por um McDonald’s.

Embora o teste de Turing seja questionável – e de já ter caído em desuso entre os pesquisadores da inteligência artificial –, até hoje nenhum exame de avaliação do pensamento inteligente obteve a aceitação geral. Há alguns bem interessantes por aí. Christof Koch e seu colega Giulio Tononi argumentam que – ao contrário do que acreditava Turing – o pontochave é avaliar o processo que o ser ou a máquina em questão utiliza, algo mais fácil de dizer que de fazer, se você não tiver acesso ao funcionamento interno do candidato. Os dois propõem que uma entidade deve ser considerada inteligente se, diante de uma cena aleatória, puder extrair o ponto principal da imagem, descrever os objetos presentes e suas relações – tanto espaciais quanto causais –, e fazer extrapolações e especulações razoáveis que ultrapassem o que estiver sendo retratado. A ideia é que qualquer câmera pode captar uma imagem, mas só um ser inteligente é capaz de interpretar o que vê, raciocinar a respeito e analisar novas situações. Para passar pelo teste de Koch-Tononi, um computador teria de integrar informações de muitos domínios, criar associações e empregar lógica.

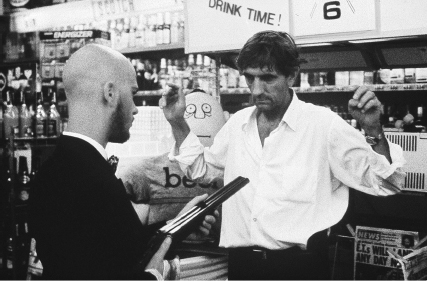

Por exemplo, olhe para a imagem do filme Repo Man, nas Figuras 3 e 4 (p.230). Um inseto rastejando pela página poderia detectar as características puramente físicas da foto – um conjunto retangular de pixels, cada um num tom de cinza. Mas, num instante e sem esforço aparente, nossa mente percebe que a imagem mostra uma cena, identifica os elementos visuais, determina quais são importantes e inventa uma provável história acerca do que está acontecendo. Para atender aos critérios do teste de Koch-Tononi, uma máquina inteligente deveria ser capaz de focar no homem armado, na vítima com as mãos para o alto e nas garrafas nas prateleiras. E deveria também concluir que a foto mostra uma loja de bebidas sendo assaltada, que o assaltante está no limite, que a vítima está apavorada e que o carro de fuga espera do lado de fora. (As cenas precisam estar sintonizadas com a base de conhecimentos culturais da pessoa ou do computador sob teste.) Até agora nenhuma máquina chegou perto disso. Qualquer abordagem grosseira e não inteligente que tenha conseguido um limitado sucesso no teste-padrão de Turing não terá chance de passar no teste de Koch-Tononi. Os dois pesquisadores acreditam que ainda é preciso muito tempo até haver um pequeno sucesso nesse teste. Aliás, só há poucos anos os computadores chegaram ao que qualquer criança de três anos consegue fazer – distinguir um cão de um gato.

Será que o pouco sucesso dos computadores até agora em chegar ao mesmo tipo de inteligência do nosso cérebro é um problema técnico que um dia conseguiremos resolver? Ou será essencialmente impossível replicar o cérebro humano?

Num sentido abstrato, o propósito tanto do cérebro quanto de um computador é processar informação, ou seja, dados e relações entre os dados. A informação depende do meio que a transporta. Por exemplo, vamos supor que você estude uma cena, tire uma foto e a escaneie no computador. Nem sua memória nem a do computador conterão uma imagem literal da cena. Em vez disso, por um arranjo de seus componentes físicos, a mente e o computador vão simbolizar a informação definida pela cena de uma maneira própria. A informação da cena física agora seria representada de três modos: a imagem fotográfica, a representação no seu cérebro e a representação no computador. Descartando-se as distorções e questões de resolução limitada, essas três representações conteriam as mesmas informações.

Turing e outros transformaram esses insights sobre a informação e como ela é processada numa ideia conhecida como “teoria computacional da mente”. Segundo ela, estados mentais como sua memória da fotografia e, de maneira mais geral, seu conhecimento e até seus desejos, são chamados de estados computacionais. Eles são representados no cérebro por estados físicos dos neurônios, assim com dados e programas são simbolizados como estados dos chips dentro dos computadores. Da mesma forma como um computador segue seus programas para processar os dados que recebe e produzir uma resposta, pensar é uma operação que processa estados computacionais e produz outros novos. É nesse sentido abstrato que a mente é como um computador. Mas Turing deu um passo adiante. Ele projetou uma máquina hipotética, chamada máquina de Turing, que em tese poderia simular a lógica de qualquer algoritmo de computador. Isso mostra que, se o cérebro humano seguir um conjunto de regras específicas, é possível construir uma máquina – em princípio – que faça essa simulação.

FIGURA 4

A teoria computacional da mente se mostrou útil como uma estrutura que os cientistas podem usar para pensar sobre o cérebro; termos comuns da teoria da informação agora são usados amplamente na neurociência, como “processamento de sinais”, “representações”, “códigos”. Isso nos ajuda a pensar sobre os processos mentais de uma forma teórica, e a entender melhor como desejos e convicções não precisam residir em outros domínios, mas podem ser incorporados ao mundo físico.

Mesmo assim, o cérebro biológico não é uma máquina de Turing. O cérebro humano pode fazer muito além de aplicar uma série de algoritmos aos dados e produzir uma resposta. Como foi descrito antes, o cérebro pode alterar sua própria programação e reagir a mudanças no ambiente – não apenas aos estímulos sensoriais externos, mas até a seu próprio estado físico. Ele tem se mostrado espantosamente elástico. Se o corpo caloso for secionado, dividindo o cérebro em duas partes, a pessoa não morre, algo continua em funcionamento, e isso é um maravilhoso testemunho de como somos diferentes das máquinas de computação que construímos. O cérebro humano pode sofrer degradação ou doença, ter grandes seções obliteradas por um derrame ou pelo impacto de um acidente, mas, ainda assim, consegue se reorganizar e seguir em frente. O cérebro também pode reagir psicologicamente, e é tão plástico em seu espírito como na capacidade de se curar. Em Stumbling on Happiness, o psicólogo Daniel Gilbert escreveu sobre um atleta que, depois de muitos anos de desagradável quimioterapia, sentiu-se alegre e disse: “Eu não mudaria nada.” E sobre um músico que ficou aleijado, mas depois afirmou: “Se eu tivesse de fazer tudo de novo, gostaria que acontecesse do mesmo jeito.” Como eles conseguem dizer coisas assim? O que for que aconteça, nós encontramos um caminho. Como diz Gilbert, a flexibilidade está ao nosso redor. São essas características da mente humana que a elevam acima de uma simples máquina algorítmica, propiciando a beleza de ser humano e o mistério maior que a ciência ainda terá de desvelar.

Da última vez que alguém lhe perguntou se estava chovendo, será que você respondeu “Vou ter de fazer a amostra de algumas variáveis aleatórias para isso”? Se uma pessoa lhe pedir para traduzir o Kalevala, o épico nacional finlandês, você responderia “Sinto muito, isso não está programado no meu software”? À primeira vista, as pessoas não pensam como computadores – máquinas que alternam dois números, 0 e 1, para chegar aos “pensamentos”. Mesmo se você acreditar, como parece o caso de Leonard, que o cérebro eventualmente irá revelar os segredos da mente, o cérebro também não opera usando 0 e 1. Na verdade, não há nenhuma semelhança entre o nosso cérebro e qualquer máquina “pensante” já planejada. Isso significa que esses pontos de interrogação não vão desaparecer.

Como era inevitável, o outrora promissor campo da inteligência artificial (IA) nem chegou perto de reproduzir um verdadeiro pensamento. Leonard falou dos problemas básicos relativos à IA, e eu poderia aquiescer e passar adiante. Mas existe uma questão crucial pairando no ar. Já que não é igual a um computador, o que o cérebro faz para produzir pensamentos? Acredito que a resposta seja clara: o cérebro não produz pensamentos, ele os transmite a partir da mente. E o que a mente faz, então? Ela cria significado. Não só isso, o significado evolui e, com isso, o cérebro vai atrás para alcançá-lo, guiado pela próxima coisa interessante sobre a qual a mente quer pensar.

Se um computador conseguisse abarcar os significados, a IA seria uma descoberta de fazer tremer o planeta. A ficção científica se tornaria realidade, pois um de seus enredos favoritos envolve computadores mais inteligentes que seus mestres homens, seja voltando-se contra eles, seja tornando-se também humanos. O computador HAL, a bordo da nave no filme 2001: uma odisseia no espaço, soa mais simpático que os astronautas robôs viajando pelo espaço sideral. A plateia fica chocada quando HAL resolve matar a tripulação, para o bem da missão, mas, ainda assim, é impressionante quando o último astronauta sobrevivente começa a desmantelar a memória de HAL, e a voz do computador moribundo pede: “Por favor, não faça isso, Dave. Estou me sentindo estranho.” O livro Eu, robô, de Isaac Asimov, explora o mesmo tema, e os escravos mecânicos da humanidade se revoltam contra seus senhores.

A capacidade que os computadores têm de nos imitar não é apenas uma brincadeira. Já mencionado por Leonard, o Eliza foi um dos mais engenhosos programas de computação. Ele usava um truque esperto, baseado numa escola de psicoterapia desenvolvida pelo psicólogo Carl Rogers nos anos 1940 e 1950, que deixava os pacientes à vontade fazendo observações empáticas de um tipo aparentemente simples, como “Entendi”, “Fale mais a esse respeito”, ou simplesmente “Hum”. A programação dessas declarações no Eliza contornou a necessidade de o computador saber tudo sobre o mundo real. Observações fáceis e enfáticas têm o poder de fazer as pessoas se sentirem ouvidas e compreendidas. Pronto, um computador que parece humano. (Aliás, diversas pessoas que conversavam com seus computadores usando o Eliza relataram resultados terapêuticos tão bons quanto os obtidos por um psiquiatra de verdade.)

Minha opinião é de que o computador nunca vai pensar – alguns truques podem apresentar uma boa imitação, mas nenhuma máquina é capaz de criar significado, de atravessar a linha que separa a mente da matéria. Porém, no instante em que digo isso, um grande obstáculo se interpõe no caminho. O cérebro é matéria e parece transitar no plano do significado. Se bits esponjosos de substâncias químicas flutuando numa aquosa célula cerebral podem transmitir as palavras “Eu te amo” e esperar, com sensível vulnerabilidade, que a outra pessoa responda “Eu também te amo”, um computador no futuro pode ser capaz de fazer o mesmo. Por que não?

Antes de mergulhar de cabeça num complexo argumento sobre mente e significado, vamos considerar o seguinte experimento. Voluntários de Harvard se inscreveram para um estudo sobre jogos de estratégia. Foram postos diante de um monitor e informados a respeito das regras de um jogo específico.

Vocês estão jogando com um parceiro que está escondido atrás de uma tela. Cada um de vocês tem dois botões para apertar, marcados com 0 e 1, respectivamente. Se os dois apertarem 1, você ganha um dólar, assim como o parceiro. Se os dois apertarem 0, você não ganha nada, nem seu parceiro. Se você apertar 0 e o seu parceiro apertar 1, você ganha cinco dólares e ele não ganha nada. O jogo vai durar meia hora. Podem começar.

Imagine que você fosse um dos jogadores – qual seria sua estratégia? Você cooperaria, pressionando 1 todas as vezes, de forma que você e seu parceiro tivessem a mesma recompensa? Ou ia preferir apertar 0, enquanto ele, inocentemente, pressionava o 1, e você conseguiria a recompensa maior? Você se sentiria tentado a fazer isso, mas, se ele ficasse zangado, poderia retaliar apertando 0 todas as vezes e obrigando-o a fazer o mesmo, e os dois acabariam sem nada.

Quando o experimento foi concluído, os sujeitos foram interrogados sobre como os jogadores atuaram, e muitos disseram que seus parceiros eram irracionais. Mesmo quando os sujeitos pressionavam 1 muitas vezes seguidas, por exemplo, sinalizando vontade de cooperar, os parceiros recusavam. Continuavam apertando 0 para ganhar cinco dólares, enquanto, em outras ocasiões, pareciam envolvidos numa sabotagem sem sentido. Era necessário castigá-los apertando 0 todas as vezes, mas isso também não os dissuadia.

Na verdade, não se tratava absolutamente de um experimento sobre jogos de estratégia, mas sobre projeção psicológica, pois não havia parceiros ocultos. Cada sujeito jogava contra um gerador numérico aleatório, que emitia 0 ou 1 sem nenhuma ordem específica. Mas quando indagados sobre como eram seus parceiros, os sujeitos projetavam neles características humanas, usando palavras como “desonesto”, “não cooperativo”, “volúvel”, “desleal”, “estúpido”, e assim por diante. A impressão é de que a mente humana cria significado até mesmo quando não há significado algum.

A mente é cheia de significados, mas as máquinas não podem trafegar por essa região. Se não tivermos um Beethoven à mão para criar uma sinfonia n. 10, um Shakespeare para produzir sua peça perdida Cardênio, ou um Picasso para programar um estilo de pintura que nunca chegou a expressar nas telas, a máquina não vai fazer isso. A inspiração criativa não pode ser reduzida a um código escrito. A inteligência artificial estava condenada desde o início, pois “inteligência” foi definida em termos de lógica e racionalidade, como se outros aspectos do pensamento humano – emoções, preferências, hábitos, condicionamento, dúvidas, originalidade, absurdos etc. – não fizessem parte do cenário. Na verdade, eles são a glória de nossa muito fantasiosa e perversamente deliciosa inteligência. O significado floresceu através de nós em todas as suas facetas, não apenas como manifestação da razão. Essas facetas incluem a irracionalidade. A guerra atômica é um exemplo desse tipo de comportamento irracional, que nos faz encolher de terror diante de nossa própria natureza, mas a Mona Lisa e Alice no País das Maravilhas são igualmente irracionais, e nós gravitamos fascinados em torno dessas obras.

Computadores são limitados por regras e precedentes, sem os quais as máquinas lógicas não conseguem operar. Eles não dizem “Quando eu sonhava acordado, alguma coisa me ocorreu”. Mas Einstein estava sempre sonhando acordado, e a estrutura do benzeno foi revelada ao químico Friedrich August Kekulé em sonho. (Ironicamente para a IA, graças a um sonho, o fisiologista alemão Otto Loewi, que ganhou o Prêmio Nobel de Medicina em 1936, descobriu como os nervos transmitem sinais.) Portanto, devemos ser gratos à irracionalidade. O filósofo francês Pascal tinha razão quando disse: “O coração tem razões que a própria razão desconhece.”

Imagino que Leonard concorde com quase tudo isso. Mas também imagino que se apegue à convicção de que, um dia, o entendimento mais profundo do cérebro – e ele aponta na direção das redes neurais – nos revelará o que é o pensamento. Mas, e se não existir tal solução? Talvez não haja um modelo do cérebro mais simples que o próprio cérebro. Isso não quer dizer que a conexão mente-cérebro não esteja evoluindo. Com certeza está. Quando a mente criou a leitura e a escrita, milhares de anos atrás, uma região do córtex adaptou-se para torná-las fisicamente possíveis. Logo que novas formas de arte moderna foram produzidas, as pessoas coçaram a cabeça, como fizeram ao surgir a teoria da relatividade, de Einstein. Com o tempo, todos aceitaram os novos fatos, e, para essas pessoas e para as gerações seguintes, o cubismo e a relatividade se tornaram uma segunda natureza, assim como ler e escrever. Quando você treina seu cérebro para ler e escrever, não pode mais voltar atrás e se tornar analfabeto. Essas marcas pretas de tinta na página sempre serão letras, e não traços aleatórios. De maneira irrevogável, o significado levou você a outro patamar.

A vida espiritual é uma questão de desenvolver os significados. Eu afirmo que a ciência, por si só, nunca estará à altura desse projeto. O fato de a mente não ser matéria vai até o cerne do meu argumento, mas há também um ponto mais técnico, que envolve um famoso argumento matemático conhecido como teoremas da incompletude de Gödel. Para entender o que esses teoremas representam na vida cotidiana, devemos observar a natureza dos sistemas lógicos. Somos as únicas criaturas que adoram todos os tipos de absurdo. “Solumbrava, e os lubriciosos touvos/ Em vertigiros persondavam as verdentes”,b mas é o sentido das coisas que nos faz sentir em casa.

Em nossa ânsia de sentido, a lógica é nossa principal ferramenta para determinar o que faz sentido e o que não faz. Mas como podemos saber que estamos certos? As leis da natureza fazem sentido porque podem ser reduzidas à matemática, um sistema totalmente lógico. Por isso dizemos que dois mais dois são quatro, e não três ou cinco. Mas será que a lógica não engana a si própria? Se assim for, o mundo talvez pareça fazer sentido quando na verdade não faz. (Milhares de anos atrás, os antigos gregos debateram-se com essa questão e encontraram enigmas desconcertantes, como alguns paradoxos. Um filósofo de Creta chamado Epimênides declarou: “Todos os cretenses são mentirosos.” Pode-se acreditar nele? Não há como saber. Ele poderia estar dizendo a verdade, mas isso significa que estava mentindo. A autocontradição está embutida na sentença.)

De forma simplificada, esse era o problema enfrentado por Kurt Gödel (1906-1978), matemático austríaco que se juntou à onda de ilustres emigrantes fugidos da Europa assolada pela guerra para morar nos Estados Unidos. A área de Gödel era a lógica que rege os números. Não precisamos entrar nesse campo especializado, a não ser para dizer que os números naturais (números de contagem como 1, 2, 3 etc.) são considerados fatos da natureza, e portanto podem representar outras coisas que encaramos como fatos. Os números devem ser coerentes; quando a eles se aplicam procedimentos, os resultados devem ser comprováveis. O mesmo pode ser dito de fatos sobre o corpo, como a frequência cardíaca e a pressão sanguínea, pois também são regidos por números. Os médicos aprendem os intervalos numéricos julgados normais, e nossa saúde é medida por esses padrões.

Gödel destilou os números até chegar à sua essência mais pura, os processos lógicos que levaram a coisas como os computadores. E ele descobriu que os sistemas lógicos têm furos inerentes. Eles contêm afirmações que não podem ser comprovadas – daí a noção de incompletude. O primeiro teorema de Gödel afirma que a incompletude é o destino de qualquer sistema lógico; nunca haverá um sistema que explique tudo. O segundo teorema diz que, se você está olhando um sistema a partir do interior, ele pode ser coerente, mas você nunca terá certeza disso enquanto continuar dentro dele. Há um ponto cego inerente, pois certas suposições não prováveis fazem parte de todo sistema. Quem quiser escapar desses furos fatais terá de arranjar um modo de sair do sistema. A lógica não pode transcender a si mesma.

A espiritualidade argumenta que a consciência pode ir até onde a lógica não consegue chegar. Há uma realidade transcendente, e, para atingi-la, é preciso vivenciá-la. Leonard, que é um sofisticado matemático, pode demonstrar como alinhavei mal essas questões altamente técnicas. Mas é difícil escapar dos principais pontos sugeridos por Gödel: os sistemas matemáticos incluem certas afirmações aceitas como verdade, mas que não podem ser comprovadas. Transportando isso para o reino dos números, Gödel está dizendo que coisas não provadas estão tecidas na nossa explicação da realidade. Os estudiosos das religiões fazem afirmações baseadas na suposição de que Deus existe, embora não possam provar. Os materialistas fazem afirmações baseadas na suposição de que a consciência pode ser ignorada, o que também não conseguem provar. Por que continuamos a viver com esses improváveis fatores X? Várias respostas me vêm à cabeça.

1. Fé: Nós acreditamos em algumas coisas, e isso nos basta.

2. Necessidade: O mundo precisa fazer sentido para nós, mesmo que haja falhas no caminho.

3. Hábito: As suposições improváveis ainda não perturbaram ninguém até agora, portanto, adquirimos o hábito de nos esquecer delas.

4. Conformidade: O sistema pode ser furado, mas todo mundo usa, então, eu também estou nessa. Quero participar.

Quando juntamos todas essas razões, os meros mortais – até os meros mortais com educação científica – acham fácil defender sistemas com furos que não desejam admitir. Porém, não é só o calcanhar de aquiles da lógica que nos atormenta. Estamos aprisionados nas implicações do segundo teorema de Gödel, de acordo com o qual um sistema lógico não pode revelar suas incoerências; a cegueira é inerente a ele. Sei que estou humanizando a matemática, o que faz de mim um completo outsider, mas os sistemas nos pegam a cada curva – sistemas políticos, religiosos, morais, de gênero, econômicos e, acima de tudo, materialistas. É vital saber que fomos condicionados a aceitar esses sistemas sem considerar suas suposições não comprovadas. (Observem que não comprovada não quer dizer errada. Não posso provar que minha mãe me amava, mas, ainda assim, isso é verdade.)

Leonard declarou diversas vezes que não podemos ansiar por coisas infantis como Deus, vida após a morte ou alma, e esperar que sejam verdadeiras. Não acho que a espiritualidade se origine de um excesso de otimismo. Ela surgiu porque os sábios, santos e visionários do mundo conseguiram escapar das limitações do sistema lógico em que Leonard tanto crê.

A percepção de Gödel pode ser estendida para nos mostrar que máquinas lógicas não podem dar saltos criativos, pois qualquer sistema que não consegue revelar seus furos internos estará sempre confinado à prisão de sua lógica. Imagine um computador que possa detectar 1 milhão de matizes de vermelho. Se você perguntar qual é a mais bonita, ele não terá nada a dizer. “Bonito” está fora de sua lógica. Felizmente a natureza se recusa a ser aprisionada pela lógica, e os seres humanos entenderam essa dica. Quando Picasso criou o cubismo, quando Tolstói imaginou Anna Karenina pulando na frente de um trem, quando Keats escreveu o esboço final de “Ode a um rouxinol” em poucos e frenéticos minutos, transformando um poema promissor numa obra-prima, a criatividade deu saltos baseados numa mistura e na comparação dos ingredientes daquilo que existia antes. A lógica não fez parte desse processo.

Leonard menciona o Deep Blue, o computador que joga xadrez. Em 11 de maio de 1997, o Deep Blue ganhou um torneio de seis jogos contra o campeão mundial Garry Kasparov. A vitória, derivada do projeto de um estudante da Universidade Carnegie Mellon, levou dez anos para ser arquitetada. Foi um choque emocional e angustiante para Kasparov (sabemos que o computador nada sentiu por ter vencido), que havia derrotado o Deep Blue um ano antes. Mas gostaria de virar essa façanha de cabeça para baixo. O Deep Blue é o exemplo perfeito de um sistema lógico autocontido, que não pode fugir de suas pressuposições básicas.

A máquina só sabia calcular números, portanto, não sabia absolutamente jogar xadrez. Só tinha capacidade para vistoriar, na velocidade da luz, o conhecimento humano programado em seus circuitos. Os grandes mestres de xadrez mostram uma adorável arrogância quanto ao que fazem. Quando embasbacados admiradores perguntaram ao lendário campeão russo Alexander Alekhine quantos movimentos à frente conseguia enxergar num jogo, ele respondeu friamente: “Só consigo ver um movimento à frente, o movimento certo.” Jogar xadrez é intuitivo. Envolve a compreensão de todo o tabuleiro, interpretar o oponente, assumir riscos e assim por diante. Os grandes mestres não memorizam milhares de jogos de cor para chegar onde estão. Eles aprendem a partir desses milhares de jogos, o que é muitíssimo diferente. A mente treina o cérebro, que por sua vez confere à mente uma plataforma mais elevada, e assim continua o processo, mente e cérebro evoluindo juntos. O Deep Blue só conseguiu engolir esse conhecimento e cuspi-lo de volta.

Finalmente, uma das áreas da IA está desenvolvendo mãos artificiais – para substituir mãos perdidas em batalhas – das quais incontáveis veteranos incapacitados e outros amputados se beneficiarão, se o projeto der certo. Rastrear os complexos sinais enviados e recebidos pela mão humana é incrivelmente difícil. Será que uma mão protética um dia conseguirá moldar uma escultura como a Vênus de Milo? Será que conseguirá sentir a dura e fria superfície do mármore? Opor-se a um tipo de trabalho tão altruísta parece errado, e os críticos da IA costumam ser tratados como inimigos do progresso. Mas precisamos levar em conta a pesquisa do neurocientista Vilayanur Ramachandran e seu incrível trabalho, no Salk Institute de San Diego, com pessoas que tiveram membros amputados.

Depois de uma amputação, muitos pacientes experimentam a sensação de membros fantasma. Sentem que a mão ou o braço perdidos continuam ali, e esses membros fantasma podem causar muita dor, em geral pela sensação de que os músculos estão sempre contraídos. O professor Ramachandran sabia que, para esse tipo de dor, as drogas, mesmo grandes doses de potentes analgésicos, são de pouca ajuda. Refletindo sobre o problema, ele deu um salto de criatividade. Pôs um paciente cujo braço direito fora amputado em frente a uma caixa com um espelho dentro, dividindo-a em dois. Pediu-se ao paciente que introduzisse o braço esquerdo na caixa e olhasse lá para dentro. O que ele viu foram dois braços – o direito era o simples reflexo do esquerdo. Mas, para quem olhava, a imagem do espelho parecia real.

Pediu-se então que o paciente abrisse e fechasse as duas mãos, a real e a fantasma. Para surpresa de todos, essa simples ação podia causar alívio, às vezes instantâneo, a uma dor aguda e intratável. O cérebro era enganado pela visão de um braço direito “real”. Ramachandran sugere que a área do cérebro que recebia os sinais dos membros (o córtex somatossensorial) estava em curto-circuito – mapeando o braço perdido e adaptando outras regiões próximas, reservadas para os pés e o rosto. Mostrar a imagem de um braço direito dentro da caixa espelhada fez com que o cérebro remanejasse o processo, possibilitando o relaxamento dos músculos fantasma. (Um curioso efeito colateral da teoria de Ramachandran, de que o cérebro tinha entrado em curto-circuito, é que às vezes as sensações do braço amputado eram transferidas para a área que recebia sensações do rosto. Dessa forma, um toque no rosto do paciente fazia com que ele relatasse a sensação de um toque no braço perdido.)

Isso só podia acontecer porque a mente, diferente do cérebro, arranjou uma forma de enganá-lo e a seus sinais de dor. Os métodos de Ramachandran estão sendo testados em hospitais de veteranos de guerra. Nem todos os amputados se beneficiam totalmente deles, e varia a quantidade de tempo passado diante da caixa com o espelho. Mas o importante foi demonstrar a possibilidade de uma súbita mudança. A neuroplasticidade, a capacidade de antigos caminhos se transformarem em novos, ganhou um novo alento.

Gostaria de ir um passo além. Se conseguíssemos descobrir o que há dentro da mente, uma porta se abriria para a inteligência superior. O truque – o truque de sempre – é que a mente só pode ser explorada pela mente. Qualquer pessoa sabe como olhar para si mesma. Nós refletimos, temos palpites, tentamos entender nossos próprios motivos. (Alguns exemplos familiares: “Por que eu disse uma coisa tão estúpida?”, “Não sei como eu sabia isso, simplesmente sabia”, “O que me fez comer aquilo tudo?”) Conhecer sua mente não é fácil. A diferença entre a vida espiritual e qualquer outra vida se reduz a isso. Na espiritualidade, você descobre o que é a mente na verdade. A consciência explora a si mesma e, longe de chegar a um beco sem saída, os mistérios se revelam. Só então a sabedoria floresce. O reino de Deus está dentro de nós; eu sou o caminho e a vida; ama teu próximo como a ti mesmo. Estas não são afirmações de fatos objetivos. Não podem ser deduzidas por meio da computação. A mente olhou fundo, em si mesma, e descobriu sua fonte, que é transcendente.

Sobre a presença de Deus, há, em Hebreus 11:3: “O que pode ser visto não foi feito do que é visível.” Se você quiser, pode comparar essa afirmação com a física quântica, mas, no final, a origem é outra, é a capacidade da mente conhecer a si mesma. Esta também é uma suposição que não pode ser comprovada, contudo, o que nos salva é que essa afirmação específica é verdadeira.

b Primeiro verso do poema “Pargarávio”, de Lewis Carroll, na tradução de Maria Luiza X. de A. Borges. Em Alice: edição comentada (Zahar, 2002). (N.T.)